TFake News: Wie KI-Bilder vom Holocaust das Internet fluten

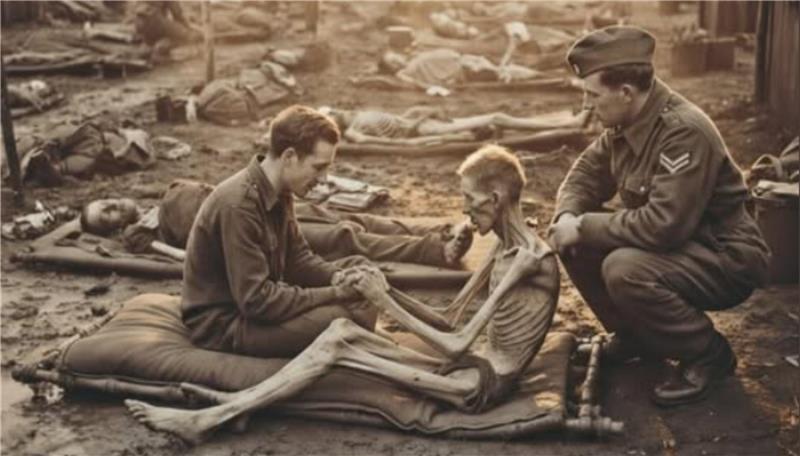

Dieser Screenshot zeigt eines der KI-generierten Bilder, die angeblich im Lager Sandbostel aufgenommen wurden, aber nicht echt sind. Foto: Screenshot Facebook

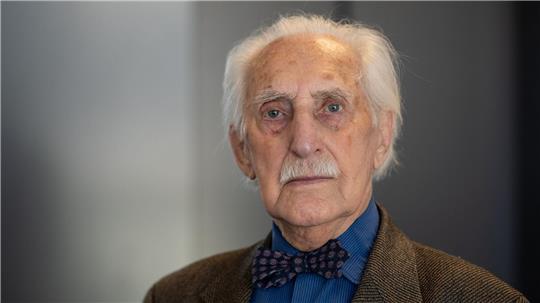

Es ist ein Missbrauch des Holocausts: KI-Bilder sollen Emotionen wecken und Geld einbringen. In einem offenen Brief wehren sich nun Gedenkstätten wie das Lager Sandbostel.

Sandbostel. Abgemagert, kahlgeschoren und kaum bekleidet sitzt ein Mann auf einem Feldbett. Ihm gegenüber ein Soldat, der seine Hand hält und ihm in die Augen blickt. Im Hintergrund sind Baracken zu sehen sowie Hunderte am Boden aufgereiht liegende, dünne Körper. Augenscheinlich zeigt das schwarz-weiße Bild einen besonderen Moment zwischen einem KZ-Häftling und einem Soldaten während des Zweiten Weltkriegs.

Ein Moment der Menschlichkeit - zu schön, um wahr zu sein

Der Text, der zu dem Foto auf Facebook hochgeladen wurde, verortet die Szene im Kriegsgefangenenlager Sandbostel, während der Befreiung. Es halte einen „Moment der Menschlichkeit“ fest. Doch dieses Bild, das hundertfach auf Social Media geliked und geteilt wurde, ist nicht echt. Es wurde mit einer künstlichen Intelligenz (KI) erstellt.

Dieser Screenshot zeigt eines der KI-generierten Bilder, das angeblich im Lager Sandbostel aufgenommen wurde. Foto: Screenshot Facebook

Seit einigen Monaten fluten massenhaft KI-generierte Bilder mit Bezug zum Holocaust das Internet. Wer durch Social-Media-Plattformen scrollt, ist so einem Bild wahrscheinlich schon begegnet und hat es vielleicht nicht einmal bemerkt.

In einem offenen Brief fordern jetzt Gedenkstätten, Museen, Verbände und Institutionen ein konsequentes Vorgehen gegen KI-generierte Holocaust-Verfälschungen auf Social-Media-Plattformen. Darunter auch die Gedenkstätte Lager Sandbostel im benachbarten Landkreis Rotenburg.

Frauen und Elektrozäune: Falsche Infos über das Lager

„Dieses Problem haben derzeit alle Gedenkstätten“, sagen Andreas Ehresmann, Leiter der Gedenkstätte Lager Sandbostel, und seine Stellvertreterin, die Archivleiterin Ines Dirolf. Die Masse an KI-generierten Inhalten verdränge die Beiträge der Institutionen, die mit historisch belegten Inhalten aufklären wollen.

Die Ersteller der KI-generierten Inhalte verbreiten offenbar rücksichtslos Falschinformationen. In der Gedenkstätte Lager Sandbostel habe es bereits Besucher gegeben, die sich nach Elektrozäunen erkundigt haben, weil sie diese auf KI-Bildern gesehen hätten. Doch solche Zäune hat es in Sandbostel nie gegeben, sagen die Leiter. Ebenso wenig wie Frauen, die durch die KI-Bilder einfach dort verortet werden.

Der Leiter der Gedenkstätte Lager Sandbostel, Andreas Ehresmann, und die stellvertretende Leiterin, Ines Dirolf, vor den Unterkunftsbaracken. Foto: P. Meyer

Doch das ist nicht das einzige Problem, erklärt Ines Dirolf. „Wir als Gedenkstätten arbeiten gezielt daran, Stereotype aufzubrechen und zu zeigen, wie vielfältig die Geschichte ist. Diese KI-Inhalte arbeiten hingegen mit extremen Klischees. Das macht unsere Arbeit zunichte.“

Glaubwürdigkeit historischer Fakten leidet unter KI-Flut

Auch die Mitinitiatorin des offenen Briefes, Dr. Iris Groschek von der Stiftung Hamburger Gedenkstätten und Lernorte zur Erinnerung an die Opfer der NS-Verbrechen, weiß, wie gefährlich solche Inhalte sind. „Mit diesen Bildern und Videos wird ein überemotionalisierter fiktiver Blick auf die Geschichte kreiert“, sagt sie. „Ein Kind, das weinend und zum Himmel schauend an einem Stacheldrahtzaun rüttelt, oder ein KZ-Häftling, der versunken in die Musik auf seiner Geige spielt - diese Aufnahmen gibt es so nicht“, erklärt Iris Groschek.

Bildmanipulationen

KZ-Gedenkstätten über Fake-KI-Bilder im Internet besorgt

Diese Bilder beeinflussen wiederum die Sehgewohnheiten der User - sie verändern sich. „Je mehr Fiktion im Umlauf ist, desto mehr verlieren auch authentische historische Dokumente an Glaubwürdigkeit. Was ist wahr, was kann ich noch glauben?“, so Iris Groschek. Gefährlich seien diese KI-Inhalte auch, weil sie bestimmte Narrative verbreiten könnten - politisch und historisch.

Die Frage nach Täter- und Opferrolle könne so gezielt gelenkt werden. Diese Mechanik öffne Türen und Tore. „Wir dürfen die Geschichtserzählung nicht den revisionistischen Kräften im Internet überlassen“, mahnt Iris Groschek. Digitale Bildung müsse ernster genommen werden.

Für mehr Klicks: KI macht KZ-Häftlinge auf Fotos attraktiver

Die Ersteller laden nicht nur KI-generierte Bilder hoch, oftmals erfinden sie auch Geschichten, die nie passiert sind. „So werden historische Fakten verwässert und falsche Erzählungen über den Holocaust verbreitet“, sagt Groschek.

Teilweise würden auch echte Bilder genommen und durch die KI verändert. Manche setzten ganze Szenen in einen anderen Kontext, andere machten die abgebildeten Menschen jünger - oder hübscher. Iris Groschek spricht hierbei von einer „Verniedlichung des Holocausts“.

Erinnerungskultur

Was wird aus den Mahnungen von Holocaust-Überlebenden?

„Das ist ein Schlag ins Gesicht für jeden Angehörigen“, sagt Andreas Ehresmann. Die Gedenkstätte Lager Sandbostel steht im engen Austausch mit Angehörigen, die Bilder oder andere Dokumente zur Verfügung gestellt haben. Bestimmte entmenschlichende Bilder würde die Gedenkstätte niemals veröffentlichen - aus Respekt. Den Erstellern der KI-Bilder sei das offenbar egal. Was gut klickt, diene ihrem Zweck.

Geld machen mit „emotionaler Wucht des Holocausts“

Doch warum werden diese Inhalte überhaupt erstellt? In vielen Fällen sei die Antwort einfach: „Geld“, sagt Andreas Ehresmann. Sogenannte Content-Farmen wollen möglichst viel Reichweite und Klicks generieren, um über Werbung Geld zu machen. Sie nutzten dazu falsche Bilder und Geschichten mit Bezug zum Zweiten Weltkrieg.

Unfreiwillig ausgezogen

Wie X-Nutzer mit Musks KI Frauen belästigen: „Bikini jetzt“

Jugend-Digitalstudie 2025

Große Social-Media-Plattformen verlieren jugendliche Nutzer

Antidemokratisch

T Reichsflaggen-Graffiti bei Bargstedt: Verfassungsfeindlich oder Schmiererei?

In dem offenen Brief ist das als „emotionale Wucht des Holocausts“ beschrieben, derer sich die Ersteller gezielt bedienen. Das Perfide dabei ist, dass die Plattform-Algorithmen derartige emotional aufgeladene Inhalte begünstigen - egal, ob sie wahr oder frei erfunden sind.

Die Gedenkstätte Lager Sandbostel sieht vor allem Probleme auf Facebook - aber auch Instagram, Tiktok oder X sind betroffen. „Diese Beiträge werden im Stundentakt gepostet“, so Ines Dirolf. Mit dem Melden dieser Inhalte alleine komme die Einrichtung nicht hinterher. Und selbst wenn: Konsequenzen habe das für die Content-Farming-Seiten meist nicht.

Auch ein kritischer Kommentar sorgt für Reichweite

Der offene Brief appelliert vor allem an die Betreiber der Social-Media-Plattformen und an die Politik. „Wir wollen, dass Plattformen proaktiv gegen geschichtsverfälschende KI-Inhalte vorgehen“, so Groschek. Zudem wird im offenen Brief die Kennzeichnung von KI-Inhalten sowie der Ausschluss aus Monetarisierungsprogrammen jener Konten gefordert. Der offene Brief kann unter https://www.gedenkstaettenforum.de/gedenkstaetten/netzwerke/netzwerk-digital-history-and-memory nachgelesen werden.

Eines macht Ines Dirolf klar: „Wir sind nicht gegen künstliche Intelligenz oder Social Media, wir nutzen selbst Instagram. Es geht uns speziell um diese KI-generierten Inhalte.“ Sie sorgt sich besonders darum, dass die KI schnell dazulernt. „Mit einem geschulten Auge erkennt man diese Bilder heute noch recht gut, aber was ist in Zukunft?“

Die Unterkunftsbaracken im Lager Sandbostel. Foto: P. Meyer

Die Experten raten Usern daher, zu hinterfragen: Wer postet diesen Inhalt? Kann das Abgebildete so stattgefunden haben? Kann das Foto so entstanden sein? Auch wenn das Bild auffällig detailliert ist oder die Gesichter gleich aussehen, könnte das ein Hinweis auf KI sein.

Wer über KI-generierte Inhalte mit Bezug zum Holocaust stößt, der sollte vor allem eins tun: diese sofort melden und auf keinen Fall reagieren. Denn auch ein kritischer Kommentar bedeutet Aufmerksamkeit und Reichweite.

Copyright © 2026 TAGEBLATT | Weiterverwendung und -verbreitung nur mit Genehmigung.